Menschen sind dazu konditioniert, aus allem Sinn und Bedeutung herauszulesen. Das formt unsere Wahrnehmung von KI. Im Umgang mit menschenähnlichen Systemen lernen wir uns selbst neu kennen, genauer: unser eigenes maschinenähnliches Verhalten.

Der Fall des Softwaredesigners Blake Lemoine ist noch in Erinnerung. Google feuerte ihn 2022, weil er glaubte, das Konversationsprogramm LaMDA (Language Model for Dialogue Application) spreche zu ihm. Lemoine twitterte: «Die Leute fragen mich immer wieder, warum ich denke, dass LaMDA empfindungsfähig ist. Es gibt keinen wissenschaftlichen Rahmen, in dem diese Feststellungen getroffen werden könnten (…) Meine Meinung über die Persönlichkeit und das Empfinden von LaMDA basiert auf meinen religiösen Überzeugungen».

Die Diagnose ist schnell gestellt: abgedrehter KI-Nerd. Aber Lemoine ist durchaus interessant als Vorbote einer neuen Zeit, und das heisst, einer Tendenz die sich immer deutlicher in KI-Kreisen abzeichnet. Genauer gesehen, handelt es sich um zwei verwandte Bias.

Apophänie und Anthropomorphismus

Salopp ausgedrückt bedeutet Apophänie: Wo nichts ist, nehmen wir etwas wahr. Apophänie bezeichnet das Hineininterpretieren von Mustern und Zusammenhängen in die Welt: Lemoine hört aus dem Computer eine Person zu ihm sprechen, so wie jemand Gesichter in den Wolken sieht oder in Zeitungen an sich gerichtete persönliche Botschaften liest.

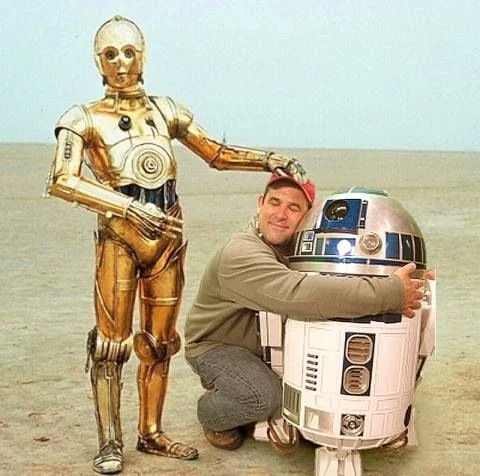

Wo nichts ist, nehmen wir etwas wahr: Gesichter in Wolken oder persönliche Botschaften in Zeitungen.

Wir sollten uns vor allzu schneller Psychiatrisierung hüten. Apophänie weist auf ein «normales» Bias hin. Wir sind mit einem kulturell geprägten kognitiven Apparat ausgestattet, der uns geneigt macht, überall Muster, Zusammenhänge, bedeutsame Koinzidenzen wahrzunehmen. Es fällt uns schwer, keinen Sinn darin zu sehen, was geschieht. Auch Unsinn ist Sinn – vielleicht Sinn hoch zwei.

Ebenso schwer fällt es uns, das, was geschieht, in nicht-menschlichen Begriffen zu beschreiben und zu erklären. Menschen können nicht nicht antropomorphisieren. Schon der Begriff des Computers ist ein Anthropomorphismus, denn ursprünglich bezeichnete er menschliche Hilfskräfte – vorwiegend weibliche –, die öde «maschinelle» Rechenaufgaben übernahmen.

Der anthropomorphe Switch

Lemoine demonstriert den «anthropomorphen Switch». Man kennt ihn seit Weizenbaums Gesprächsprogramm ELIZA. Lemoine weiss durchaus, dass er sich mit einer Maschine unterhält, und dennoch «kippt» er von der technischen zur persönlichen Einstellung. Ludwig Wittgensteins hat dies in seinen «Philosophischen Untersuchungen» sehr klar thematisiert: «Denke, ich sage von einem Freunde: ‚Er ist kein Automat.’ – Was wird hier mitgeteilt, und für wen wäre es eine Mitteilung?» Unter normalen Umständen, so Wittgenstein, bedeutet dies, dass der Freund «sich immer wie ein Mensch, nicht manchmal wie eine Maschine benimmt». Und unter solchen Umständen ist «meine Einstellung zu ihm eine Einstellung zur Seele. Ich habe nicht die Meinung, dass er eine Seele hat.»

Eine Seele haben – oder wie ich zu sagen vorziehe: eine Person sein – ist nicht eine Frage der Meinung, sondern des zwischenmenschlichen Zusammenlebens. Es erscheint uns absurd, einen Menschen zuerst hypothetisch als Person zu betrachten und dann diese Hypothese zu testen, wenn möglich sogar zu verwerfen. KI-Systeme konfrontieren uns aber genau mit dieser Absurdität.

Ein neues Zeitalter der Maschine

Werden wir also künftig «switchen» müssen? Nicht wenigen Zeitgenossen mutet ein solches Szenario abwegig an. Noch mit den fremdartigsten Menschen verbindet uns ja eine gewisse gemeinsame Humanität. Auch mit Tieren und Pflanzen teilen wir gemeinsame Lebensvollzüge. Aber was teilen wir mit künstlichen fremden Intelligenzen ausser ein paar Strukturen abstrakten Denkens?

Wir müssen das binäre Denken über Mensch und Maschine aufbrechen.

Mit dieser Frage überschreiten wir die Schwelle zu einem neuen Zeitalter der Maschine. Das heisst, wir müssen das binäre Denken über Mensch und Maschine aufbrechen. Wie Kate Darling vom Media Lab des MIT argumentiert, werden wir es in den künftigen Mensch-Maschine-Interaktionen mit einem Kontinuum unterschiedlicher Einstellungen zu tun haben – ganz ähnlich wie in unserem Umgang mit Tieren, von den Amöben bis zu den Bonobos.

Partiell unbegreifliche Maschinen

Genügend vielschichtige neuronale Netze sind Black Boxes. Sie haben Milliarden von Parametern, die sie automatisch einstellen, und sie funktionieren damit zwar oft überraschend gut, indem sie Voraussagen mit erstaunlicher Genauigkeit liefern. Bei der Beurteilung von KI-Ergebnissen erliegen wir gern einer Selbsttäuschung. Der Computerwissenschaftler Drew McDermott prägte 1976 dafür den Begriff der «wunscherfüllenden Eselsbrücke» («wishful mnemonics»): Wir können all die komplizierten Rechenprozesse im KI-System nicht mehr vollständig computertechnisch beschreiben, deshalb wünschen wir, dass sie es wie wir tun. Faute de mieux greifen wir zu psychologischen «Eselsbrücken», vollziehen den anthropomorphen Switch.

Das ganze branchenübliche Marketing stellt denn auch auf vollmundiges Ankündigen von menschenähnlichen Fähigkeiten ab. Zum Beispiel: «Watson kann alle Texte über Gesundheitsfürsorge in Sekunden lesen» (IBM). Oder: «Das KI-Modell hat den Menschen im Verstehen von natürlichen Sprachen überflügelt» (Microsoft). Kein Wort davon, was man mit «lesen» und «verstehen» meint.

Das KI-System dressiert den Nutzer

Sprachliche Grossmodelle mögen stochastische Papageien und in diesem Sinn «seelenlos» sein; nichtsdestoweniger prägen sie unseren zwischenpersönlichen Verkehr. Ihre soziale Präsenz als interaktive Agenten ist schon nicht mehr wegzudenken. Sie definieren eine neue Kategorie von Maschinen, die man als partiell unbegreiflich bezeichnen könnte.

LaMDA begegnet uns als Konversationspartner, GPT-3 wird heute als ein künstlicher Autor gefeiert, DALL-E 2 als künstlicher Illustrator. Der Nutzer dressiert dem KI-System seine Eigenheiten an, und rückwirkend imitiert das System den Nutzer auf eine Weise, die seinen Hang zu Apophänie und Anthropomorphismus verstärkt.

Beseelung der Maschine – Maschinisierung der Seele

Angenommen, es gelinge uns, völlig menschenähnliche Roboter zu bauen, deren Verhalten nicht mehr vom menschlichen zu unterscheiden ist, von denen wir aber wüssten, dass sie keine Menschen sind. Die zentrale Frage dabei ist nicht, ob wir Maschinen mit Bewusstsein und «Seele» bauen können. Die Frage lautet vielmehr: Was heisst es, mit Artefakten zusammenzuleben, die sich so verhalten, als ob sie bewusst und «seelenvoll» wären? Und wenn wir erst einmal Maschinen mit Seele zu akzeptieren begonnen haben, sind wir dann nicht nahe daran, auch unsere Seele als maschinell – als auf einer Neuromaschine laufend – zu begreifen?

Was heisst es, mit Artefakten zusammenzuleben, die sich so verhalten, als ob sie bewusst und «seelenvoll» wären?

In diesem Zusammenhang konstatiert man ja ein Paradox: Neurowissenschaftler tendieren heute dazu, unser gewohntes psychologisches Vokabular – wie etwa «denken», «glauben», «wissen», «fühlen», «bewusst sein» – in Gehirnsprache zu übersetzen. Die umgangssprachlich-psychologische Terminologie scheint ihnen nicht zu genügen, um menschliches Verhalten zu erklären. Umgekehrt aber haben die Computerdesigner offenbar keine Schwierigkeiten, ihre Artefakte nun mit jenem psychologischen Vokabular zu beschreiben, das – zumindest aus neurowissenschaftlicher Sicht – als obsolet gilt.

Lernen wir uns neu kennen!

Die in Science-Fiction-Szenarios immer wieder variierte Schreckensvision einer Übernahme der Herrschaft durch intelligente Maschinen spiegelt im Grunde das Unbehagen vor einem Teil unserer selbst. Wir alle sind Maschinen in dem Sinne, dass wir vieles roboterartig tun, lies: routinemässig, mechanisch, ohne nachzudenken, seelenlos. Im Roboter vor uns blickt uns der Roboter in uns an.

Im Roboter vor uns blickt uns der Roboter in uns an.

Die ganze KI-Technologie ist ein Appell an uns selbst: Lernen wir uns im Zeitalter einer posthumanen Spezies neu kennen! Gerade der Chatbot hat diesen Prozess jetzt angestossen. Er erweitert den Raum möglicher fremder Intelligenz und verschafft uns dadurch die Gelegenheit, unsere eigene Intelligenz vergleichend neu zu bestimmen: Was genau ist der menschliche Faktor? Das wäre das Projekt einer Anthropologie im Anthropozän – oder besser: im Maschinozän. Wer sagt uns denn, dass Intelligenz in ihren zahlreichen Varianten schon erforscht sei?

Lassen wir dabei vor allem nicht jene ausser Acht, die das grösste Interesse an der «Beseelung» der Maschine haben: die KI-Barone und ihre Grossunternehmen. Ihr Blick richtet sich auf die Kolonisierung unserer Seelen.